Эпоха простых чат-ботов осталась в прошлом. Новыми героями бизнес-процессов становятся автономные ИИ-агенты. Эти продвинутые виртуальные помощники способны дообучаться под специфические задачи предприятия: они самостоятельно анализируют контекст, думают и предпринимают конкретные действия. Однако для того, чтобы ИИ-агенты приносили реальную пользу, им необходимо создать соответствующие условия. Они генерируют принципиально иной профиль вычислительной нагрузки, требуя переосмысления подходов к работе с локальными данными и к архитектуре информационной безопасности, что неизбежно подталкивает традиционные ИТ-системы к эволюции.

Ситуация на рынке существенно усложняется сложившимся дефицитом электроэнергии, оперативной и флэш-памяти, который станет жестким технологическим фильтром для организаций в ближайшие 12 месяцев. По оценкам аналитиков TrendForce, в 2025 г. глобальный спрос на серверную динамическую память (DRAM) со стороны ЦОД вырос более чем на 30%, а цены на модули оперативной памяти и корпоративные твердотельные накопители (SSD) за полгода увеличились в 1,5–2 раза. Скупка высокопроизводительного оборудования поставщиками тяжелых ИИ-кластеров вымывает запасы с рынка, заставляя предприятия по-новому планировать размеры и жизненный цикл своей инфраструктуры.

Децентрализация искусственного интеллекта

Последние прорывы в области ИИ в значительной степени были достигнуты благодаря очень большим генеративным моделям (например, LLM). Их требования к аппаратному обеспечению многократно превышали возможности обычного оборудования, которое на архитектурном уровне плохо приспособлено к таким нагрузкам. Этот разрыв стал причиной вынужденной централизации ИИ: тяжелые модели могли запускаться только в облачных ЦОД с удалённым доступом.

Такой подход неизбежно увеличивает время отклика, а для ряда задач, например, для промышленной автоматизации, решений дополненной и виртуальной реальности (AR/VR) или автономного транспорта, даже десятки миллисекунд задержки становятся критичными. Кроме того, удаленный доступ к LLM создает серьезные риски с информационной безопасностью и соблюдением регуляторных требований, поскольку корпоративные данные необходимо передавать по внешним сетям. Зависимость от интернет-подключения также приводит к тому, что вся система предприятия перестаёт работать при потере связи.

Сегодня этот технологический разрыв успешно закрывается с двух сторон. Во-первых, создаются малые языковые модели (SLM) и узкоспециализированные алгоритмы, которые значительно менее требовательны к вычислительным ресурсам. Во-вторых, современные стандартные серверы и рабочие станции массово оснащаются средствами аппаратного ускорения для задач ИИ. В результате генеративные модели могут полноценно работать локально — прямо внутри корпоративной инфраструктуры заказчика, без подключения к внешним облачным сервисам.

Для бизнеса децентрализация ИИ означает появление сценариев, где решения принимаются «на месте» — быстро, автономно и без зависимости от удаленных серверов. Ключевые преимущества такого подхода:

- Мгновенная реакция: система на базе компьютерного зрения на производственной линии анализирует продукцию на локальном сервере, выявляя брак в режиме реального времени. Это снижает задержку до десятков миллисекунд и сокращает финансовые потери от брака.

- Оптимизация трафика: в розничной торговле системы аналитики потоков посетителей и управления выкладкой работают на локальных серверах прямо в магазине или логистическом хабе. На центральные серверы уходят только готовые результаты аналитики, а не «сырые» массивы данных.

- Безопасность и комплаенс: чувствительная информация не покидает защищенный периметр компании, что кардинально упрощает соблюдение требований по защите персональных данных и взаимодействие с регуляторами.

Репатриация и суверенизация

В последние годы естественным ответом на растущие глобальные риски стало ярко выраженное стремление перенести ключевые элементы ИТ-инфраструктуры в локальный, независимый контур.

На уровне отдельных компаний этот процесс набирает темп в виде «репатриации» — стратегического увеличения доли локальной инфраструктуры и целенаправленного возврата критически важных рабочих нагрузок из публичных облаков обратно в корпоративные периметры. На государственном уровне этот же тренд носит название «суверенизация». Широко обсуждаемые сегодня концепции «суверенного ИИ» — это лишь часть общего, глобального вектора, который в 2026 г. будет только усиливаться.

В этих условиях корпоративным заказчикам предстоит решать сложную архитектурную задачу: им нужно будет постоянно балансировать между эластичностью и гибкостью, которые предлагают публичные облака, и необходимостью сохранять полный контроль над своими данными и инфраструктурой в собственных ЦОД, а также на периферийных (edge) узлах. Как прямое следствие этого тренда, на корпоративном рынке существенно усилятся и станут обязательными требования импортонезависимых решений и надежных локальных технологических стеков.

Эволюция ЦОД

Эволюционное развитие архитектуры центров обработки данных (ЦОД) традиционно делится на три основных этапа: эра мэйнфреймов (1950–1980-е гг.), клиент-серверная архитектура (1990–2000-е гг.) и эра облачных вычислений (начиная с 2010-х). В современных дата-центрах эти архитектуры не являются взаимоисключающими; напротив, они пересекаются, что позволяет плавно осуществлять эволюционные изменения ИТ-инфраструктуры. Однако очевидно, что для эффективной работы ИИ необходим новый подход.

Формирование облика новых AI-native ЦОД происходит под одновременным влиянием гигаваттных ИИ-фабрик (кластеров высокопроизводительных вычислений), инновационных решений по жидкостному охлаждению, энергоменеджменту и компонуемой архитектуре. Сегодня, когда организации переходят от экспериментов к масштабируемым решениям ради измеряемых бизнес-результатов, наибольшего успеха добьются те предприятия, которые сумеют выстроить распределенную, но жестко управляемую инфраструктуру ИИ.

Повышение эффективности через управление ИИ-нагрузками

С переходом к массовому применению ИИ на первый план выходит т.н. «токеномика» — экономическая целесообразность генерации результатов разными моделями. Базовым стандартом корпоративной эффективности становится семантическая маршрутизация запросов. В этой модели система автоматически анализирует запрос пользователя и подключает ту или иную нейросеть в зависимости от специфики задачи. Например, базовая классификация входящих писем или простой поиск по базе знаний маршрутизируется на быстрые и экономичные малые модели, тогда как составление сложного квартального отчета передается мощным универсальным большим моделям.

Внедряется идея иерархии ИИ-агентов, использующих разные модели. В такой структуре происходит четкое разделение труда: ИИ-агенты высокого уровня используют более современные и тяжелые модели, способные к рассуждениям, в то время как другие, подчиненные им агенты низкого уровня, выступают в роли исполнителей.

Повышение эффективности использования аппаратных ресурсов

В традиционных ЦОД серверы для новых ИИ-нагрузок часто закупаются монолитно и «с запасом» по основным аппаратным ресурсам. Из-за этого фактическая среднегодовая загрузка центральных процессоров (CPU) и памяти редко превышает 40–50%, а графические ускорители (GPU) простаивают в ожидании пиков.

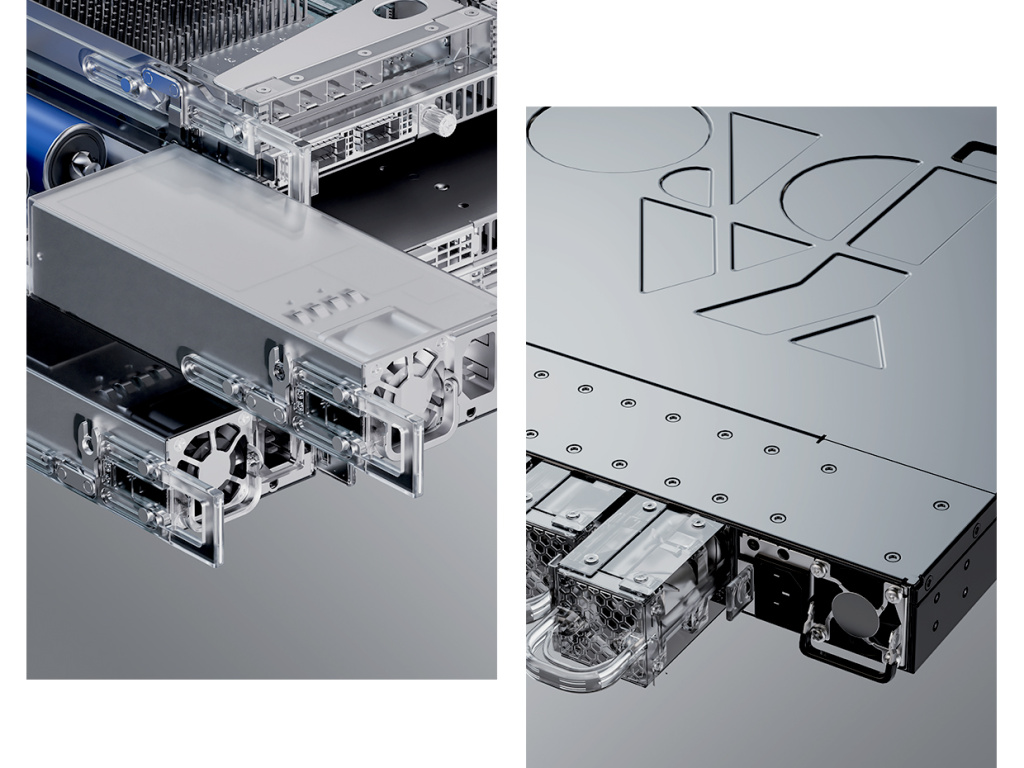

Решением становится переход к компонуемой дезагрегированной инфраструктуре (КДИ), когда вычислительные мощности, память, хранилища и ускорители разделяются на независимые пулы и динамически собираются в систему под конкретную задачу. Нагрузки с разным профилем распределяются по этим пулам, что позволяет организациям сократить избыточное резервирование ресурсов до 50%. Для заказчика это означает фундаментальный переход от «сервероцентричной» архитектуры к «ресурсоцентричной»: он управляет не парком серверов, а пулами ресурсов. КДИ позволяет закупать меньше оборудования, гибко обновлять отдельные компоненты, увеличить среднюю загрузку ресурсов до 70–80% и, как следствие, снизить капитальные затраты на 20–30%.

Корпоративная информационная безопасность для ИИ

Интеграция автономных ИИ-агентов в бизнес-процессы требует фундаментального пересмотра подходов к защите данных. Главная архитектурная сложность заключается в том, что генеративные модели искусственного интеллекта непредсказуемы и вероятностны по своей природе, тогда как критические системы предприятия детерминированы. Предоставление ИИ прямого доступа к таким системам несет неприемлемые риски. Безопасность AI-Native предприятия требует обязательного внедрения встроенных проверок на всех уровнях ИТ-инфраструктуры.

Новый центральный элемент безопасной AI-Native инфраструктуры — специализированные интеграционные шлюзы. Они играют роль изолированного посредника между миром ИИ-вычислений и классическими серверами приложений. Эти шлюзы фильтруют и переводят хаотичные намерения ИИ-агентов в безопасные, стандартизированные API-запросы с учетом корпоративных ролевых моделей.

Конвергенция миров за счет физического ИИ

В 2026 г. ожидается резкое ускорение конвергенции — сближения и взаимопроникновения виртуального и реального миров. Искусственный интеллект совершает переход от бестелесных алгоритмов к физическим системам, которые воспринимают окружающую среду через датчики, принимают решения и действуют в реальном мире с помощью роботов и исполнительных механизмов. Нас ждет массовое внедрение антропоморфных роботов, автономных дронов и промышленных помощников.

Параллельно объекты реального мира всё чаще приобретают цифровых двойников. В этих симуляциях реальность влияет на модель, а модель (воспроизводя физику и динамику процессов) влияет на реальность. Это позволяет обучать ИИ в виртуальной среде до реального запуска оборудования, сокращая циклы разработки в десятки раз. Для бизнеса это означает острую необходимость подготовить инфраструктуру к растущему объему потоковых данных.

Важно, что физический ИИ уже дает измеримый бизнес-эффект. Так, внедрение автономных мобильных роботов и дронов позволяет оптимизировать складскую логистику, а цифровые двойники производственных линий позволяют тестировать изменения алгоритмов до вывода на реальное оборудование, снижая долю брака.

*Yadro входит в ИКС Холдинг